Gemini 2.0 rappresenta una nuova evoluzione delle intelligenze artificiali generative e della personalizzazione che, come abbiamo visto per ChatGPT, è fondamentale. Presentato da Google DeepMind l’11 dicembre 2024, questo modello multimodale punta a diventare il punto di partenza di una nuova generazione di assistenti intelligenti.

Gemini 2.0: come funziona

Indice dei contenuti

Il nuovo modello si basa su progressi significativi rispetto alle versioni precedenti, con capacità che vanno ben oltre la semplice elaborazione del linguaggio naturale:

- multimodalità nativa: supporto per input e output in formato testo, immagini, video e audio, incluso il text-to-speech multilingue.

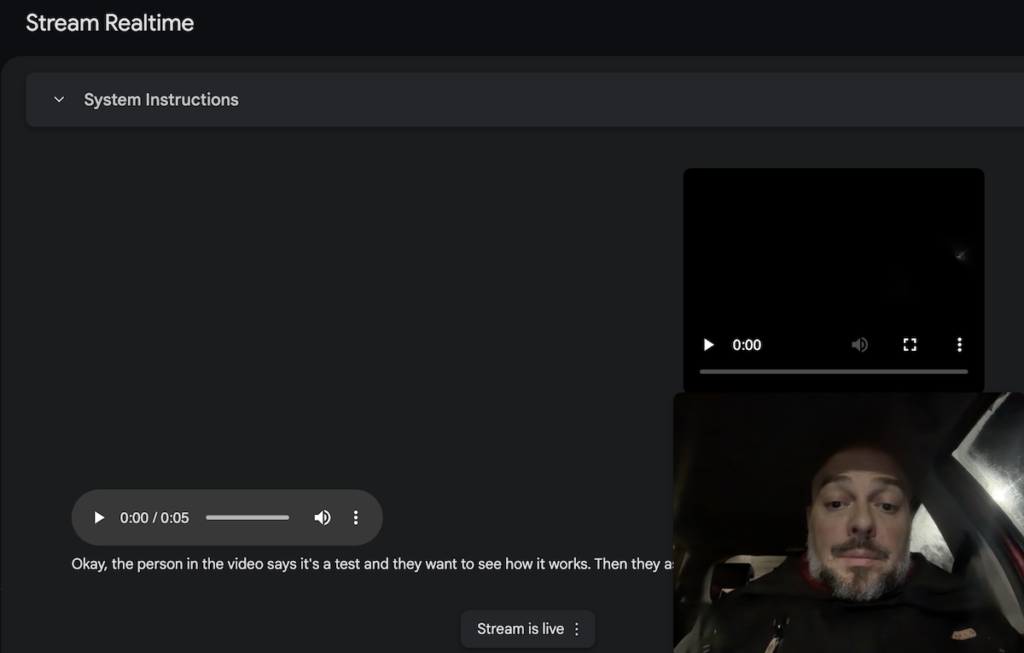

La multimodalità video si può provare qui e funziona anche con il live streaming.

- uso nativo di strumenti: integrazione con funzioni avanzate come Google Search, esecuzione di codice e API di terze parti.

- prestazioni: la versione Flash di Gemini 2.0 è due volte più veloce della precedente 1.5 Pro, con prestazioni superiori su benchmark chiave.

Gemini 2.0 su Google AI Studio

Gemini 2.0 è il modello sperimentale disponibile per gli sviluppatori tramite Google AI Studio e Vertex AI. Offre risposte multimodali, combinando immagini e audio generati nativamente con output testuali.

- funzioni avanzate: generazione in tempo reale di immagini, analisi contestuale di video-streaming e output audio personalizzabili.

- accesso per sviluppatori: grazie alle API Live Multimodal, gli sviluppatori possono creare applicazioni interattive che sfruttano le capacità multimodali del modello

Progetti sperimentali: Astra, Mariner e Jules

Google DeepMind sta esplorando le applicazioni di Gemini 2.0 attraverso tre prototipi principali:

- Project Astra: un assistente universale che combina memoria personalizzata, comprensione multimodale e strumenti come Google Lens e Maps. È in fase di test su dispositivi Android e prototipi di occhiali intelligenti.

- Project Mariner: un agente progettato per navigare il web, capace di comprendere e interagire con elementi come testo, codice e immagini all’interno del browser.

- Jules: un agente di codifica che assiste gli sviluppatori integrandosi direttamente nei workflow di GitHub, dall’analisi delle issue alla scrittura del codice.

Applicazioni pratiche nei giochi e nella robotica

Gemini 2.0 apre nuove possibilità anche nel mondo dei giochi e della robotica:

- Gaming: il modello può interpretare le regole dei giochi e suggerire strategie in tempo reale, collaborando con sviluppatori come Supercell.

- Robotica: le capacità di ragionamento spaziale di Gemini 2.0 vengono applicate a prototipi per l’interazione con l’ambiente fisico

Gemini 2.0 e la sicurezza

Google DeepMind, nel post di presentazione, sottolinea l’importanza di uno sviluppo responsabile:

- Red teaming potenziato: Gemini 2.0 utilizza la propria capacità di ragionamento per generare automaticamente valutazioni e dati di addestramento, migliorando la sicurezza su larga scala.

- Privacy e mitigazione dei rischi: gli utenti hanno controllo sulle informazioni condivise con gli agenti, con opzioni per eliminare sessioni e protezioni contro istruzioni malevole.

- Ricerca continua: ci sono nuovi protocolli per prevenire abusi, come phishing o frodi

Lascia un commento